Entwicklung eines einheitlichen Rahmens für die kombinierte auditive und visuelle Datenanalyseansätze

Hintergrund

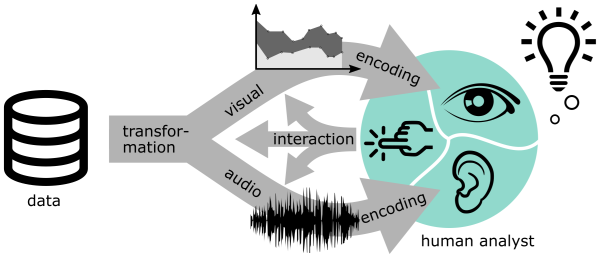

Das Auswerten von Daten wie zum Beispiel in der Analyse von Produktionsprozessen erfordert viele Schritte, die sich nicht vollständig automatisieren lassen. Meist ist die Arbeit von Analyst*innen, also Menschen, erforderlich. Derartige Analyseansätze zwischen automatisierter Auswertung und menschlicher Interpretation und Steuerung wurden sowohl im Forschungsfeld der Informationsvisualisierung als auch der Sonifikation, der „Verklanglichung“, also der Darstellung von Daten in Klängen, entwickelt. Während Informationsvisualisierungsansätze die computerbasierte, interaktive visuelle Darstellung von Daten erforschen, veranschaulicht Sonifikation Information auditiv durch nicht-sprachliche Klänge. Im Angesicht steigender Datenmengen und -komplexität stoßen aber beide Ansätze an ihre Grenzen, zumal die Wahrnehmungskapazitäten von Menschen als Grundlage der Interpretation der Bilder und Klänge limitiert sind.

Obwohl bereits zahlreiche Studien die auditive oder die visuelle Repräsentation von Daten untersuchten, gab es nur wenige Versuche diese beiden Kanäle zu kombinieren. Es fehlen Datenanalyseansätze, die beides auf systematische und komplementäre Weise kombinieren; also die gegenseitige Beeinflussung der Kanäle berücksichtigen. Bestehende Versuche waren oft auf einen Kanal fokussiert und vernachlässigten den anderen. Deshalb gibt es noch keinen etablierten methodischen Ansatz Informationsvisualisierung und Sonifikation in Form einer komplementären Designtheorie zu kombinieren.

Projektinhalt und -ziele

Das Projekt SoniVis zielt darauf ab, die Lücke zwischen Sonifikation und Visualisierung zu schließen. Dabei soll die Basis für eine vereinheitlichte Designtheorie einer audio-visuellen Analytics gelegt werden, die den visuellen und den auditiven Kanal miteinander ergänzt. Dafür vereinigt das Projekt Kompetenzen aus den Feldern der Informationsvisualisierung und Sonifikation.

Im Rahmen des Projekts werden wir

- die Bandbreite der Designmöglichkeiten für komplementäre audio-visuelle Datenanalyseansätze abstecken;

- die praktische Umsatzbarkeit in Form einer Designstudie anhand der Analyse von Produktionsprozessen untersuchen; und

- ein kontrolliertes Experiment durchführen, um verschiedene komplementäre audio-visuelle Analytics-Ansätze empirisch zu vergleichen.

Methode und Ergebnisse

Das Projekt stellt den Menschen in den Mittelpunkt (human-centred) und verfolgt einen problemorientierten Forschungsprozess der auf dem Paradigma des Design Science Research basiert. Die Phasen des Entwurfs und der Evaluierung sind eng miteinander verzahnt, sodass Ansätze zeitnah überprüft werden können und so das Risiko nicht aussagekräftiger Ergebnisse reduziert wird.

Erwartete Forschungsergebnisse sind in erster Linie Designprinzipien (Kernprinzipien und Konzepte zur Steuerung des Designs) und Instanziierungen (digitale Artefakte, d.h. situierte Implementierungen in bestimmten Umgebungen). Darauf aufbauend arbeiten die Forschenden an einer Designtheorie zur Integration von interaktiver Visualisierung und Sonifikation für Datenanalyseaufgaben.

Publikationen

Presseberichte

Neuer Artikel über audiovisuelle Datenanalyse publiziert

22.04.2024Medium: MeinBezirk.at

Redakteurin: Stefanie Machtinger

Hören und Sehen miteinander verbinden

30.06.2022Forscher*innen der FH St. Pölten verknüpfen unser Hören und Sehen für die Analyse von Daten

"Sehen und Hören in Einklang bringen"

22.01.2021Medium: Die Presse

Autorin: Veronika Schmidt